برنامه های اسکن CSAM اپل کنار گذاشته شد. تنظیم کننده صحبت می کند

برنامههای اسکن CSAM اپل ممکن است کنار گذاشته شده باشد، اما این به بحث پایان نداده است. یک نهاد تنظیم کننده استرالیایی، شرکت کوپرتینویی را متهم کرده است که چشم خود را بر استثمار جنسی کودکان بسته است.

او گفت که اپل و مایکروسافت هر دو اقدامی برای محافظت از “آسیب پذیرترین افراد در برابر درنده ترین” انجام نمی دهند.

زمینه

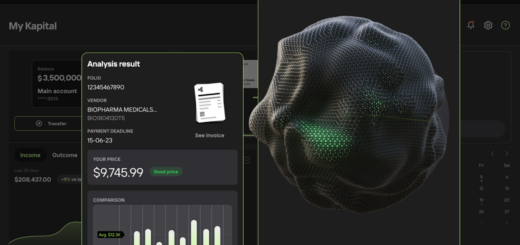

روش معمول برای شناسایی مواد سوء استفاده جنسی از کودکان (CSAM) زمانی است که سرویسهای ابری مانند Google Photos عکسهای آپلود شده را اسکن میکنند و آنها را با پایگاه دادهای از تصاویر شناخته شده CSAM مقایسه میکنند. این پایگاه داده توسط NCMEC و سازمان های مشابه در سراسر جهان ارائه شده است.

فرآیند تطبیق واقعی از چیزی که به عنوان هش یا اثر انگشت دیجیتال شناخته میشود، استفاده میکند. این از عناصر کلیدی تصویر مشتق شده است و عمداً مبهم است به طوری که در صورت تغییر اندازه، برش یا پردازش دیگر تصاویر به کار خود ادامه می دهد. این به این معنی است که گاهی اوقات موارد مثبت کاذب وجود خواهد داشت: یک تصویر بی گناه که اتفاقاً هش آن به اندازه کافی با تصویر CSAM مطابقت دارد.

اپل یک رویکرد دوستدار حریم خصوصی را برنامه ریزی کرد، که در آن اسکن روی آیفون کاربر انجام می شد، نه در فضای ابری – اما کارشناسان امنیت سایبری، سازمان های حقوق بشر، دولت ها و کارمندان خود اپل، همگی چهار نگرانی را در مورد این برنامه ها مطرح کردند.

در حالی که اپل از واکنش متعجب به نظر میرسید، ما در آن زمان به این موضوع اشاره کردیم که با توجه به پیامهای دائمی مبتنی بر حریم خصوصی این شرکت مبنی بر اینکه «آنچه در آیفون اتفاق میافتد در آیفون باقی میماند» این کاملاً قابل پیشبینی بود.

این شرکت بیلبوردهای بزرگی را نصب کرده است. تبلیغات سرگرم کننده ای اجرا کرده است. این یک میکروسایت کل حریم خصوصی دارد. مدیر عامل آن در هر مصاحبه و حضور عمومی در مورد حریم خصوصی صحبت می کند. این شرکت به غول های فناوری دیگر به دلیل حفظ حریم خصوصی حمله می کند. با کل صنعت تبلیغات بر سر یک ویژگی جدید حریم خصوصی مبارزه کرد.

پس از اینکه در ابتدا اعلام کرد که عرضه را متوقف می کند تا نگرانی های مطرح شده را در نظر بگیرد و تدابیر حفاظتی بیشتری را در مورد حفظ حریم خصوصی اعمال کند، شرکت بی سر و صدا تمام ارجاعات به آن را حذف کرد. وقتی از اپل سؤال شد، گفت که این ویژگی به تعویق افتاده است، نه لغو. با این حال، هفته گذشته تغییر کرد.

در همان روزی که این شرکت حفاظت از داده های پیشرفته را با رمزگذاری سرتاسر برای همه داده های iCloud اعلام کرد، به اسکن CSAM که هرگز منتشر نشده بود نیز پایان داد. این خبر توسط کریگ فدریگی، معاون مهندسی نرم افزار اپل در مصاحبه با جوآنا استرن از WSJ تایید شد.

رگولاتور استرالیایی اپل را به چشم پوشی متهم کرد

رویترز گزارش می دهد که کمیسر امنیت الکترونیک استرالیا، اپل و مایکروسافت را متهم کرده است که نقش خود را در جلوگیری از اشتراک گذاری CSAM ایفا نکرده اند.

کمیسیون امنیت الکترونیک، دفتری که برای محافظت از کاربران اینترنت راه اندازی شده است، گفت که پس از ارسال درخواست های قانونی برای اطلاعات به برخی از بزرگترین شرکت های اینترنتی جهان، پاسخ ها نشان می دهد که اپل و مایکروسافت به طور پیشگیرانه مواد آزار کودکان را در سرویس های ذخیره سازی خود بررسی نکرده اند. ، iCloud و OneDrive.

اینمن گرانت گفت، یک هفته پیش اعلامیه اپل مبنی بر توقف اسکن حساب های iCloud برای سوء استفاده از کودکان، به دنبال فشار طرفداران حفظ حریم خصوصی، “گامی بزرگ به عقب عقب تر از مسئولیت های آنها برای کمک به حفظ امنیت کودکان” بود.

او اضافه کرد که شکست هر دو شرکت در شناسایی سوء استفاده از پخش زنده به این معناست که “برخی از بزرگترین و ثروتمندترین شرکت های فناوری در جهان چشم خود را بسته اند و گام های مناسب را برای محافظت از آسیب پذیرترین افراد در برابر غارتگران ناکام گذاشته اند.”

اینکه آیا اپل میتواند جایگاه جدید خود را حفظ کند یا نه، باید دید. این شرکت ممکن است در آینده با یک الزام قانونی برای شناسایی CSAM مواجه شود.

عکس: Priscilla Du Preez/Unsplash

FTC: ما از پیوندهای وابسته خودکار برای کسب درآمد استفاده می کنیم. بیشتر.

برای اخبار بیشتر اپل، 9to5Mac را در یوتیوب بررسی کنید:

لینک کوتاه مقاله : https://5ia.ir/Nfpwim

کوتاه کننده لینک

کد QR :

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

آخرین دیدگاهها