استارتاپ مهندسی سریع Vellum.ai 5 میلیون دلار به عنوان تقاضا برای مقیاس های خدمات هوش مصنوعی مولد افزایش می دهد.

به گزارش سایت نود و هشت زوم استارتاپ مهندسی سریع Vellum.ai 5 میلیون دلار به عنوان تقاضا برای مقیاس های خدمات هوش مصنوعی مولد افزایش می دهد.

که در این بخش به محتوای این خبر با شما کاربران گرامی خواهیم پرداخت

امروز صبح، Vellum.ai گفت که یک دور بذر 5 میلیون دلاری را بسته است. این شرکت جدای از اینکه شرکتی چند مرحلهای است، به اشتراک گذاشتن سرمایهگذار اصلیاش برای راند خودداری کرد، اما به TechCrunch گفت که Rebel Fund، Eastlink Capital، Pioneer Fund، Y Combinator و چندین فرشته در این دور شرکت کردند. .

این استارتآپ برای اولین بار در آخرین روز نمایشی Y Combinator (زمستان 2023) توجه TechCrunch را به خود جلب کرد، زیرا تمرکز آن بر کمک به شرکتها برای بهبود پیشنهادات هوش مصنوعی مولد خود است. با توجه به تعداد مدلهای هوش مصنوعی مولد، سرعت پیشرفت آنها، و تعداد دستههای تجاری که آماده استفاده از مدلهای زبان بزرگ (LLM) هستند، ما تمرکز آن را دوست داشتیم.

با توجه به معیارهایی که Vellum با TechCrunch به اشتراک گذاشت، بازار نیز آنچه را که استارتآپ میسازد دوست دارد. به گفته آکاش شارما، مدیرعامل و یکی از بنیانگذاران Vellum، این استارتاپ امروز 40 مشتری پرداخت کننده دارد که درآمد آنها بین 25 تا 30 درصد در ماه افزایش می یابد.

برای شرکتی که در ژانویه امسال متولد شده است، این قابل توجه است.

معمولاً در یک بهروزرسانی کوتاه بودجه از این نوع، من کمی زمان صرف جزئیات شرکت و محصولش میکنم، روی رشد تمرکز میکنم و با هم همراه میشوم. با این حال، از آنجایی که ما در حال بحث در مورد چیزی کمی نوپا هستیم، اجازه دهید وقت خود را صرف کنیم تا در مورد مهندسی سریع به طور کلی صحبت کنیم.

پوشش ساختمان

شارما به من گفت که او و هم بنیانگذارانش (نوآ فلاهرتی و سید سیتپالی) کارمندان دوور، یکی دیگر از شرکتهای Y Combinator متعلق به دوران 2019 بودند و در اوایل سال 2020، زمانی که بتای آن منتشر شد، با GPT 3 کار میکردند.

زمانی که در دوور بودند، برنامههای هوش مصنوعی مولد برای نوشتن ایمیلهای استخدام، شرح شغل و موارد مشابه ساختند، اما متوجه شدند که زمان زیادی را صرف درخواستهایشان میکنند و نمیتوانند درخواستها را در تولید نسخهسازی کنند، یا کیفیت آنها را اندازهگیری کنند. بنابراین آنها نیاز به ساخت ابزارهایی برای تنظیم دقیق و جستجوی معنایی داشتند. شارما گفت که حجم زیادی از کار با دست در حال افزایش بود.

این بدان معنا بود که تیم به جای ساختن برای کاربر نهایی، زمان مهندسی را صرف ابزارسازی داخلی میکرد. به لطف آن تجربه و پیشینه عملیات یادگیری ماشینی دو هم بنیانگذار او، زمانی که ChatGPT سال گذشته منتشر شد، آنها متوجه شدند که تقاضای بازار برای ابزارهایی برای بهتر کردن اعلان های هوش مصنوعی مولد “به صورت تصاعدی رشد خواهد کرد.” از این رو، Vellum.

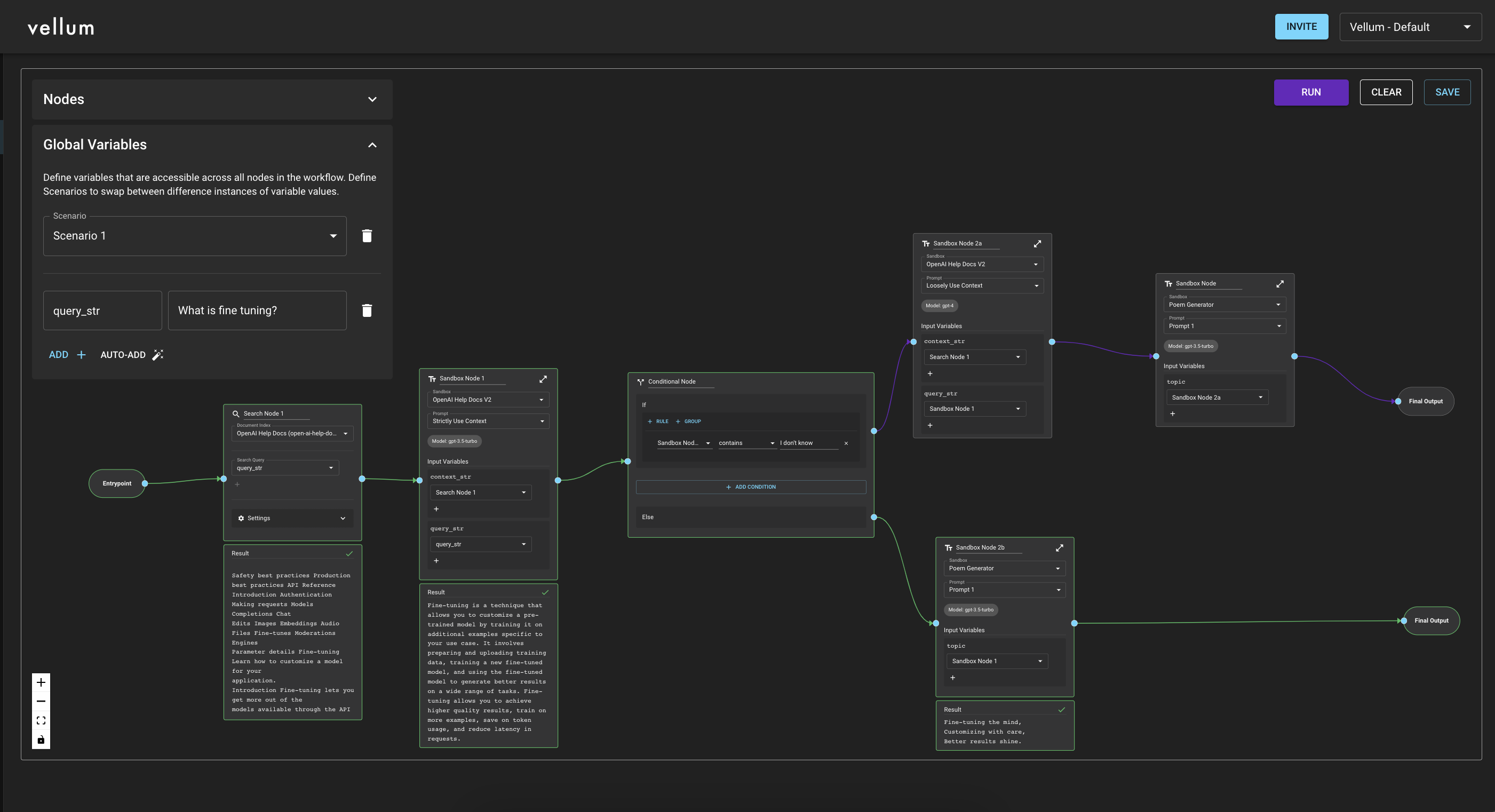

گردش کار LLM در داخل Vellum. اعتبار تصویر: ولوم

دیدن بازاری که فرصتهای جدیدی برای ساخت ابزار ایجاد میکند، چیز جدیدی نیست، اما LLMهای مدرن نه تنها ممکن است خود بازار هوش مصنوعی را تغییر دهند، بلکه میتوانند آن را بزرگتر کنند. شارما به من گفت که تا زمان انتشار LLM های اخیراً منتشر شده «هیچوقت امکان استفاده از زبان طبیعی وجود نداشت [prompts] برای به دست آوردن نتایج از یک مدل هوش مصنوعی.” تغییر به پذیرش ورودی های زبان طبیعی باعث می شود [AI] بازار بسیار بزرگتر است زیرا می توانید یک مدیر محصول یا یک مهندس نرم افزار داشته باشید […] به معنای واقعی کلمه هر کسی یک مهندس سریع باشد.»

قدرت بیشتر در دست های بیشتر به معنای تقاضای بیشتر برای ابزار است. در مورد آن موضوع، Vellum راهی را برای اعلانهای هوش مصنوعی ارائه میکند تا خروجی مدل را در کنار یکدیگر مقایسه کنند، توانایی جستجوی دادههای خاص شرکت برای افزودن زمینه به درخواستهای خاص، و ابزارهای دیگری مانند آزمایش و کنترل نسخه که شرکتها ممکن است دوست داشته باشند. به منظور اطمینان از اینکه پیام های آنها چیزهای صحیح را بیرون می اندازد.

اما درخواست LLM چقدر می تواند سخت باشد؟ شارما میگوید: چرخاندن یک نمونه اولیه مبتنی بر LLM و راهاندازی آن ساده است، اما زمانی که شرکتها در نهایت چیزی شبیه به [that] برای تولید، آنها متوجه می شوند که موارد لبه زیادی وجود دارد که نتایج عجیبی را ارائه می دهند.” به طور خلاصه، اگر شرکتها میخواهند که LLMهایشان بهطور مداوم خوب باشد، باید کارهای بیشتری نسبت به خروجیهای GPT ساده که از پرسوجوهای کاربر منبع میشوند، انجام دهند.

با این حال، این کمی کلی است. چگونه شرکتها از دستورات تصفیهشده در برنامههایی استفاده میکنند که نیاز به مهندسی سریع دارند تا اطمینان حاصل شود که خروجیهایشان به خوبی تنظیم شده است؟

برای توضیح، شارما به یک شرکت نرم افزاری پشتیبانی بلیط اشاره کرد که هتل ها را هدف قرار می دهد. این شرکت میخواست یک نماینده LLM بسازد که بتواند به سؤالاتی مانند «میتوانید برای من رزرو کنید؟» پاسخ دهد.

ابتدا به یک اعلان نیاز داشت که به عنوان طبقهبندی کننده تشدید کار کند تا تصمیم بگیرد که آیا این سؤال باید توسط یک شخص پاسخ داده شود یا LLM. اگر قرار بود LLM به این پرس و جو پاسخ دهد، مدل باید – ما به تنهایی مثال را در اینجا گسترش می دهیم – بتواند این کار را بدون توهم یا خارج شدن از ریل به درستی انجام دهد.

بنابراین، LLM ها را می توان به هم متصل کرد تا نوعی منطق را ایجاد کند که از طریق آنها جریان می یابد. بنابراین، مهندسی سریع، صرفاً نودل کردن با LLMها برای تلاش برای وادار کردن آنها به انجام کاری عجیب نیست. به نظر ما، این چیزی بیشتر شبیه برنامه نویسی زبان طبیعی است. این برنامه به چارچوب ابزاری خاص خود، مشابه سایر اشکال برنامه نویسی، نیاز دارد.

بازار چقدر بزرگ است؟

TechCrunch+ بررسی کرده است که چرا شرکت ها انتظار دارند بازار هوش مصنوعی مولد سازمانی به نسبت های بسیار زیاد رشد کند. ماینرهای زیادی (مشتریان) باید وجود داشته باشند که برای استفاده حداکثری از هوش مصنوعی مولد به بیل و بیل (ابزار مهندسی سریع) نیاز دارند.

Vellum از به اشتراک گذاشتن طرح قیمت گذاری خود خودداری کرد، اما توجه داشت که هزینه خدمات آن در سه تا چهار رقم در ماه است. با بیش از سه دوجین مشتری، که به Vellum نرخ اجرای کاملا سالمی برای یک شرکت مرحله اولیه می دهد. افزایش سریع تقاضا با اندازه بازار مرتبط است، بنابراین منصفانه است که بگوییم واقعاً تقاضای سازمانی قوی برای LLM وجود دارد.

این خبر خوبی برای تعداد زیادی از شرکت هایی است که LLM را ایجاد، استقرار یا پشتیبانی می کنند. با توجه به تعداد استارت آپ ها در این ترکیب، ما به روزهای روشن و آفتابی آینده نگاه می کنیم.

امیدواریم از این مقاله مجله نود و هشت زوم نیز استفاده لازم را کرده باشید و در صورت تمایل آنرا با دوستان خود به اشتراک بگذارید و با امتیاز از قسمت پایین و درج نظرات باعث دلگرمی مجموعه مجله 98zoom باشید

لینک کوتاه مقاله : https://5ia.ir/iMC

کوتاه کننده لینک

کد QR :

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

آخرین دیدگاهها