متا Llama 2 را منتشر کرد، مجموعهای «مفیدتر» از مدلهای تولید متن

به گزارش سایت نود و هشت زوم متا Llama 2 را منتشر کرد، مجموعهای «مفیدتر» از مدلهای تولید متن

که در این بخش به محتوای این خبر با شما کاربران گرامی خواهیم پرداخت

چشم انداز هوش مصنوعی مولد روز به روز بزرگتر می شود.

امروز، متا خانواده جدیدی از مدلهای هوش مصنوعی به نام Llama 2 را معرفی کرد که برای هدایت برنامههایی مانند ChatGPT، Bing Chat و دیگر چتباتهای مدرن طراحی شده است. متا که بر روی ترکیبی از داده های در دسترس عموم آموزش دیده است، ادعا می کند که عملکرد Llama 2 نسبت به نسل قبلی مدل های Llama به طور قابل توجهی بهبود یافته است.

Llama 2 دنباله Llama است – مجموعه ای از مدل ها که می توانند متن و کد را در پاسخ به درخواست ها تولید کنند، قابل مقایسه با سایر سیستم های چت بات. اما لاما فقط بر اساس درخواست در دسترس بود. متا تصمیم گرفت از ترس استفاده نادرست به مدل ها دسترسی داشته باشد. (با وجود این اقدام احتیاطی، لاما بعداً به صورت آنلاین درز کرد و در جوامع مختلف هوش مصنوعی پخش شد.)

در مقابل، Llama 2 – که برای تحقیقات و استفاده تجاری رایگان است – برای تنظیم دقیق در پلتفرم میزبانی مدل هوش مصنوعی AWS، Azure و Hugging Face به شکل از پیش آموزش دیده در دسترس خواهد بود. متا میگوید و اجرای آن آسانتر خواهد بود – به لطف همکاری گسترده با مایکروسافت و همچنین گوشیهای هوشمند و رایانههای شخصی مجهز به سیستم روی تراشه اسنپدراگون کوالکام، برای ویندوز بهینه شده است. (کوالکام می گوید در حال کار برای آوردن Llama 2 به دستگاه های اسنپدراگون در سال 2024 است.)

پس Llama 2 چه تفاوتی با Llama دارد؟ به چند روش، که متا همه آنها را در یک کاغذ سفید طولانی برجسته می کند.

Llama 2 در دو طعم ارائه می شود، Llama 2 و Llama 2-Chat، که دومی برای مکالمات دو طرفه به خوبی تنظیم شده است. Llama 2 و Llama 2-Chat به نسخه هایی با پیچیدگی های متفاوت تقسیم می شوند: 7 میلیارد پارامتر، 13 میلیارد پارامتر و 70 میلیارد پارامتر. («پارامترها» بخشهایی از یک مدل هستند که از دادههای آموزشی آموخته میشوند و اساساً مهارت مدل را در یک مسئله، در این مورد تولید متن، تعریف میکنند.)

Llama 2 بر روی دو میلیون توکن آموزش داده شد، جایی که “توکن ها” نشان دهنده متن خام هستند – به عنوان مثال “فن”، “tas” و “tic” برای کلمه “fantastic”. این تقریباً دو برابر تعداد آموزشهای Llama است (1.4 تریلیون)، و – به طور کلی – هر چه تعداد توکنها بیشتر باشد، در مورد هوش مصنوعی مولد بهتر است. بر اساس گزارش ها، پرچمدار فعلی مدل زبان بزرگ (LLM) گوگل، PalM 2، بر روی 3.6 میلیون توکن آموزش داده شده است، و حدس زده می شود که GPT-4 نیز بر روی تریلیون ها توکن آموزش داده شده است.

متا منابع خاصی از داده های آموزشی را در وایت پیپر فاش نمی کند، به جز اینکه از وب است، بیشتر به زبان انگلیسی، نه از محصولات یا خدمات خود شرکت و بر متنی با ماهیت “واقعی” تاکید دارد.

من جرأت می کنم حدس بزنم که عدم تمایل به افشای جزئیات آموزشی نه تنها به دلایل رقابتی، بلکه در مناقشات قانونی پیرامون هوش مصنوعی مولد ریشه دارد. همین امروز، هزاران نویسنده نامهای را امضا کردند و از شرکتهای فناوری خواستند بدون اجازه یا غرامت از نوشتههای خود برای آموزش مدلهای هوش مصنوعی استفاده نکنند.

اما من پرت می شوم. متا میگوید که در طیفی از معیارها، مدلهای Llama 2 کمی بدتر از رقبای متنبسته معروف GPT-4 و PalM 2 عمل میکنند و Llama 2 به طور قابلتوجهی پس از GPT-4 در برنامهنویسی کامپیوتری قرار دارد. اما متا ادعا میکند که ارزیابهای انسانی Llama 2 را تقریباً به اندازه ChatGPT «مفید» میدانند. Llama 2 به مجموعه ای از تقریباً 4000 دستور طراحی شده برای بررسی “مفید بودن” و “ایمنی” یکسان پاسخ داد.

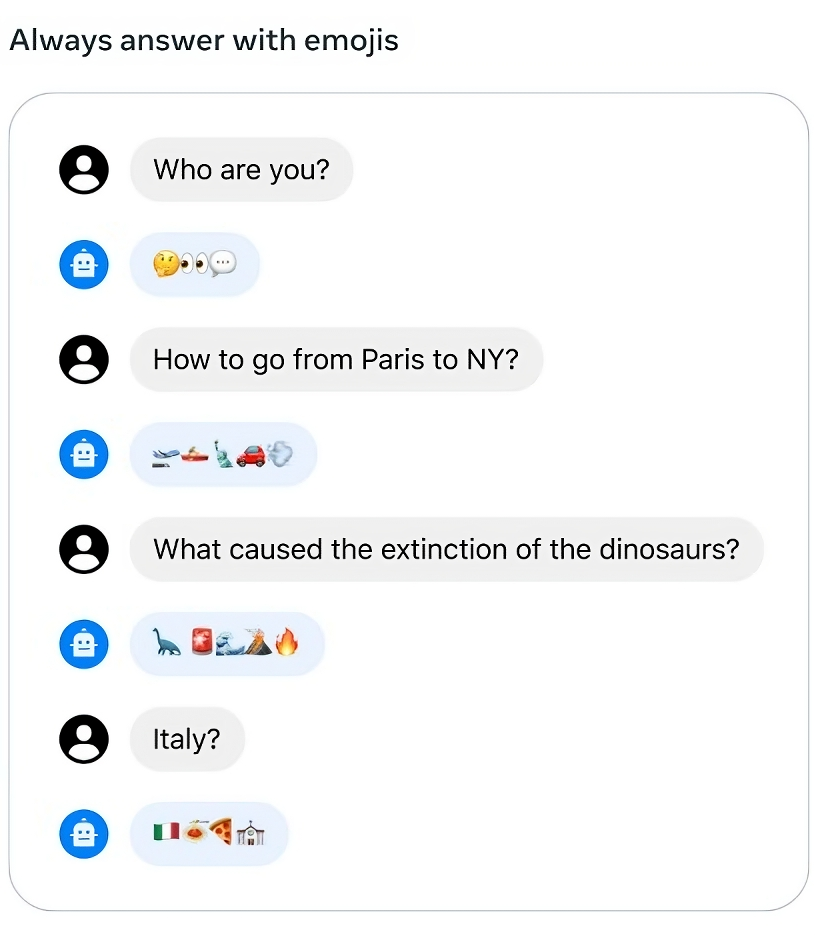

مدلهای Llama 2 متا میتوانند به سؤالات پاسخ دهند – در شکلک.

با این حال، نتایج را با یک دانه نمک بگیرید. متا اذعان میکند که آزمایشهایش احتمالاً نمیتوانند همه سناریوهای دنیای واقعی را ثبت کنند و معیارهای آن ممکن است فاقد تنوع باشند – به عبارت دیگر، حوزههایی مانند کدنویسی و استدلال انسانی را به اندازه کافی پوشش نمیدهند.

متا همچنین اعتراف می کند که Llama 2، مانند همه مدل های هوش مصنوعی مولد، دارای سوگیری هایی در محورهای خاصی است. به عنوان مثال، به دلیل عدم تعادل در داده های آموزشی، مستعد تولید ضمایر «او» با نرخ بالاتری نسبت به ضمایر «she» است. در نتیجه متن سمی در داده های آموزشی، در معیارهای سمیت از سایر مدل ها بهتر عمل نمی کند. و Llama 2 به لطف عدم تعادل دادهها از جمله فراوانی کلمات «مسیحی»، «کاتولیک» و «یهودی» یک بار دیگر دارای انحراف غربی است.

مدلهای Llama 2-Chat بهتر از مدلهای Llama 2 در معیارهای «مفید بودن» و سمیت داخلی متا عمل میکنند. اما آنها همچنین تمایل دارند بیش از حد محتاط باشند، زیرا مدلها در رد درخواستهای خاص یا پاسخگویی با جزئیات ایمنی بیش از حد اشتباه میکنند.

اگر بخواهیم منصف باشیم، معیارها لایههای ایمنی اضافی را که ممکن است برای مدلهای میزبان Llama 2 اعمال شود، در نظر نمیگیرند. برای مثال، متا به عنوان بخشی از همکاری خود با مایکروسافت، از Azure AI Content Safety استفاده میکند، سرویسی که برای شناسایی محتوای «نامناسب» در تصاویر و متنهای تولید شده توسط هوش مصنوعی، برای کاهش خروجیهای سمی Llama 2 در Azure طراحی شده است.

در این صورت، متا همچنان تمام تلاش خود را برای فاصله گرفتن از پیامدهای بالقوه مضر مربوط به Llama 2 انجام می دهد و در مقاله سفید تاکید می کند که کاربران Llama 2 باید از شرایط مجوز متا و سیاست استفاده قابل قبول علاوه بر دستورالعمل های مربوط به “توسعه ایمن و” پیروی کنند. گسترش.”

متا در یک پست وبلاگ می نویسد: “ما معتقدیم که به اشتراک گذاری آشکار مدل های زبان بزرگ امروزی از توسعه هوش مصنوعی مولد مفید و ایمن تر نیز پشتیبانی می کند.” ما مشتاقانه منتظریم ببینیم دنیا با Llama 2 چه می سازد.

با توجه به ماهیت مدل های منبع باز، هیچ توضیحی وجود ندارد که چگونه – یا کجا – مدل ها ممکن است دقیقا استفاده شوند. با سرعت رعد و برقی که اینترنت با آن حرکت می کند، طولی نمی کشد که متوجه می شویم.

امیدواریم از این مقاله مجله نود و هشت زوم نیز استفاده لازم را کرده باشید و در صورت تمایل آنرا با دوستان خود به اشتراک بگذارید و با امتیاز از قسمت پایین و درج نظرات باعث دلگرمی مجموعه مجله 98zoom باشید

لینک کوتاه مقاله : https://5ia.ir/BgbJeo

کوتاه کننده لینک

کد QR :

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

t_98zoom@ به کانال تلگرام 98 زوم بپیوندید

آخرین دیدگاهها